Une perche de ravitaillement («boom») en mode automatique vient d’être testée sur un avion ravitailleur A330-MRTT. Appelé à être bientôt certifié, ce système dit “A3R” (Air-to-Air Refueling) utilise une technologie de suivi visuel d’objet 3D basée modèle développée pour le guidage de véhicules aériens autonomes. Le principe en a été introduit voici une dizaine d’années lors d’une preuve de concept née d’une collaboration entre Airbus Defence & Space et Lagadic, une équipe de recherche en vision robotique à Rennes.

Dans un ravitaillement par perche, l’avion récepteur vient se positionner derrière et en dessous du ravitailleur. À bord de l’avion citerne, un opérateur déploie une perche télescopique qu’il doit guider et insérer manuellement dans un réceptacle situé derrière le cockpit de l’autre appareil. Cette manœuvre délicate exige concentration et précision. D’où l’idée d’Airbus de développer un système de perche entièrement automatique. Objectifs : réduire la charge de travail, améliorer la sécurité et optimiser le taux de transfert en diminuant le temps nécessaire à l’opération. “Quand l’opérateur active le système, explique Airbus, cela déploie automatiquement la perche et maintient l’alignement entre cette perche et l’avion. L’alignement et la stabilité de l’avion ravitaillé sont vérifiés en temps réel pour garder une distance de sécurité et choisir le moment idéal pour sortir le prolongement télescopique qui effectue la connexion. Le transfert de carburant commence. Une fois celui-ci terminé, la déconnexion s’effectue. Le prolongement télescopique est rétracté et la perche éloignée de l’avion récepteur pour maintenir une distance de sécurité. Durant toute cette manœuvre, l’opérateur se contente d’observer son bon déroulement.” Ce mode complètement automatique a été testé avec succès en 2020. La phase de certification doit débuter en 2021. L’avion s’appellera désormais SMART MRTT.

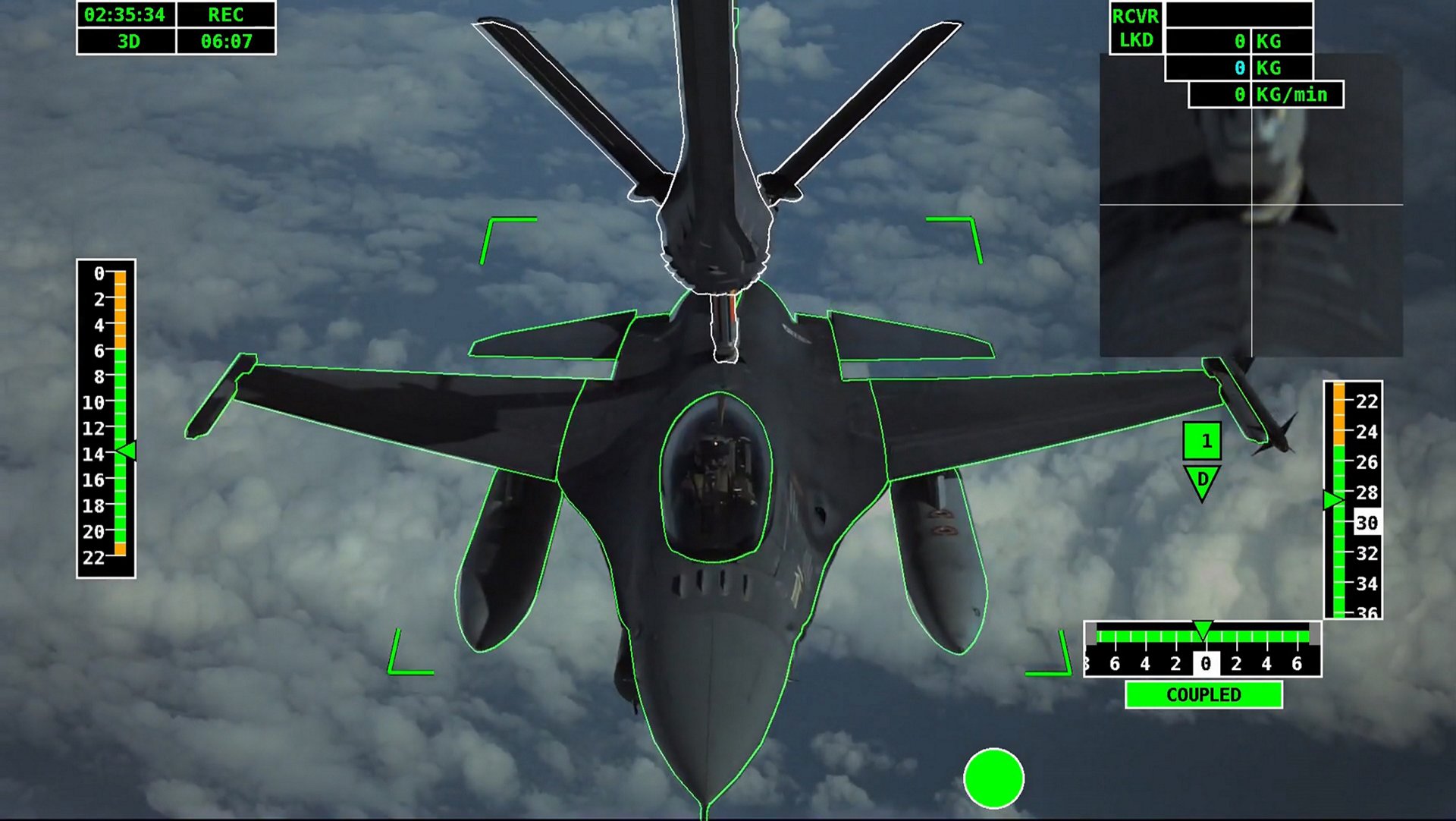

Les premiers contacts pour ravitaillement entre un Airbus A330-MRTT et un chasseur F-16. A l’image : l’avion comme il est vu par la caméra de suivi. La ligne verte indique un alignement parfait avec la projection du modèle car l’avion se trouve dans la position et à la distance voulue. Photo: Airbus.

Cette réussite de la R&D d’Airbus Defence & Space vient couronner de nombreuses années de collaboration avec Inria. “Nous travaillons effectivement avec l’industriel depuis longtemps, confirment Éric Marchand (1) et François Chaumette (2), deux scientifiques spécialisés notamment dans la localisation d’objets 3D et leur suivi visuel en temps réel. Entre autres choses, la Fondation Airbus a financé une thèse de doctorat en 2010-2013 pour explorer le potentiel de cette technologie, en particulier dans le contexte de l’enlèvement de débris spatiaux en orbite.”

Co-encadré par Éric Marchand et Keyvan Kanani, ingénieur en vision par ordinateur dans la branche spatiale d’Airbus Defence & Space (3), ce travail de thèse a été effectué par Antoine Petit (4). “Antoine a aussi développé une preuve de concept pour le suivi par un hélicoptère Caracal d’un avion de transport Airbus A400M équipé d’un tuyau et d’un panier de ravitaillement. Bien que ce fût cette fois-ci l’inverse (c’est-à-dire l’aéronef ravitaillé localisant le ravitailleur et se positionnant par rapport à lui), ces travaux ont montré que les algorithmes proposés parvenaient à localiser l’avion avec une assez bonne précision.”

Preuve de concept

Fondamentalement, les algorithmes de suivi visuel reposent sur une connaissance a priori. “Si l’on connaît le modèle 3D d’un objet observé, on peut projeter ce modèle sur l’image, puis minimiser l’erreur entre la projection du modèle et la position réelle de l’objet. Quand tous deux sont bien recalés, on peut alors en déduire la position exacte de cet objet par rapport à la caméra, ou la position de la caméra par rapport à l’objet. Dans les travaux d’Antoine Petit, par rapport aux méthodes classiques de suivi visuel basées modèle, la particularité a consisté à considérer des objets aux formes complexes impossibles à exprimer par la combinaison de quelques primitives géométriques simples. Il a développé une méthode basée sur les discontinuités de profondeur (sans devoir mesurer cette profondeur !) pour choisir les mesures bas-niveau utilisées dans le processus de minimisation d’erreur. Il s’agissait d’une preuve de concept développée au stade TRL3 par un laboratoire académique. Des années plus tard, Airbus Defence & Space a complètement redéveloppé le logiciel pour en faire un produit industriel breveté de niveau TRL8-TRL9.”

Applications multiples

“Quand nous avons décidé de financer cette thèse de doctorat, il n’y avait pas d’objectif spécifique à atteindre, se souvient Keyvan Kanani. Nous développions nos connaissances en vision par ordinateur. À cette époque, nous explorions ce domaine dans un contexte où l’Agence Spatiale Européenne pointait des thèmes de recherche très amont avec, en vue, des applications comme le ravitaillement de satellites ou la réparation en orbite. Plus tard, alors que la thèse était déjà en cours, l’ESA a annoncé un programme pour la récupération de débris spatiaux, de satellites inertes, etc. Intéressés par le projet, nous avons décidé de travailler avec Inria là-dessus. Cela a abouti à plusieurs articles publiés ensemble” et une preuve de concept prometteuse.

“Le gros avantage de notre approche vient du fait qu’elle est très générique. Elle peut servir à plein de choses, que ce soit de la navigation de drone, de l’exploration spatiale, du ravitaillement en vol, ou bien encore en robotique et réalité augmentée. Et d’ailleurs, alors que le travail de R&D avait démarré dans un contexte spatial, la première application opérationnelle s’est faite dans le secteur aéronautique.”

Outils de navigation basée vision

En s’appuyant sur les résultats de recherche, l’entreprise a finalement choisi de construire son propre logiciel. “Nous avons conservé le concept mais réécrit intégralement tout le code, éliminant au passage les imperfections habituelles que l’on peut s’attendre à trouver dans un prototype de recherche.” Ce logiciel maison s’appelle EdgeFlow. Il a rejoint la panoplie d’outils de navigation basée-vision développés par Airbus Defence & Space pour le rendez-vous spatial, la rentrée et la descente dans une atmosphère planétaire, l’atterrissage ou même le voyage interplanétaire.

“Ce fut très enrichissant de travailler avec Eric Marchand, François Chaumette et Antoine Petit, conclut Keyvan Kanani. De mon point de vue, la collaboration avec un laboratoire académique produit ses meilleurs résultats quand l’industriel se trouve en phase initiale d’exploration d’un nouveau thème scientifique. Ultérieurement, les choses peuvent parfois se compliquer pour différentes raisons. En particulier, il arrive que nos cas d’usages deviennent trop spécifiques pour la recherche académique. En ce moment, nous avons une autre collaboration qui marche très bien sur une phase d’exploration d’un nouveau sujet. Cette fois-ci, nous travaillons avec Inria sur un thème en rapport avec l’intelligence artificielle.”

|