Watch Angelos

Abstract

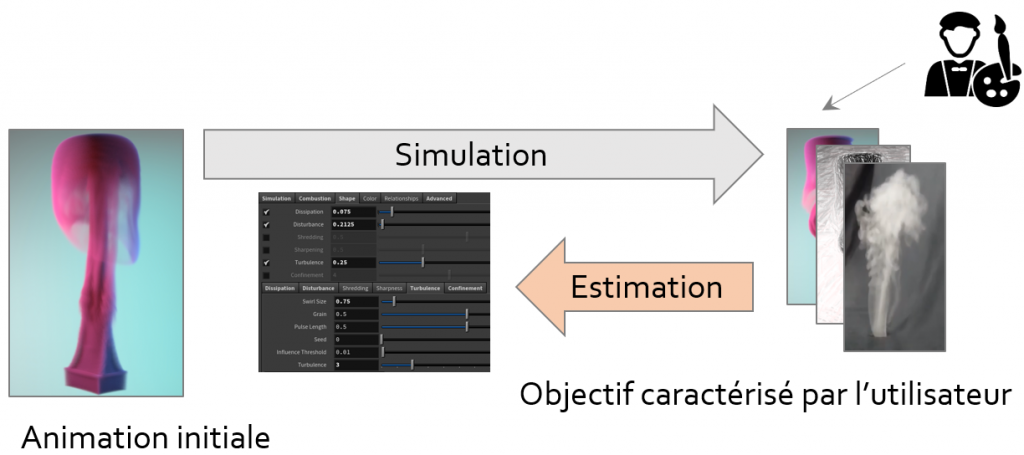

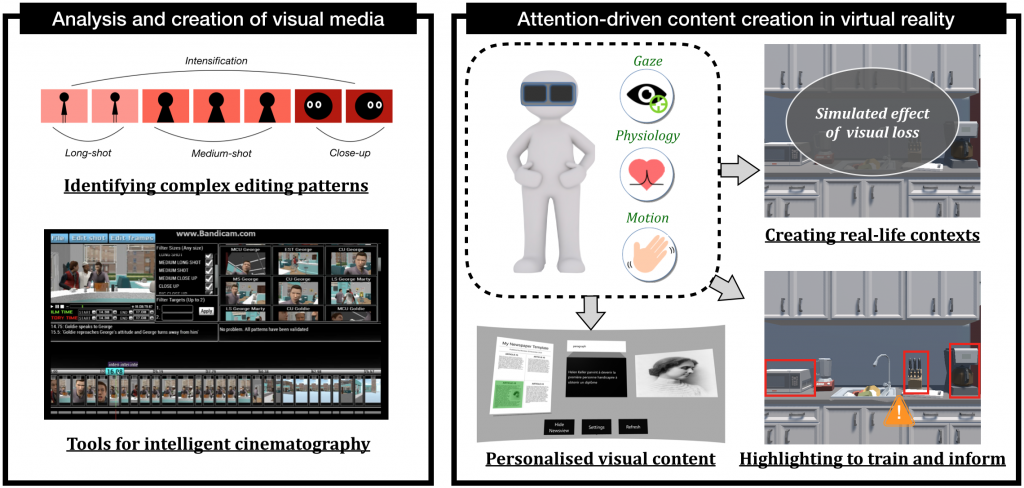

In this talk I will present Isogeometric analysis, which is a new field of research devoted to the interaction of the two, mostly disjointly operated disciplines, Computer Aided Design, that deals with questions of size and shape, and numerical simulation, that is concerned with discretization and approximation methods and their efficient implementation.

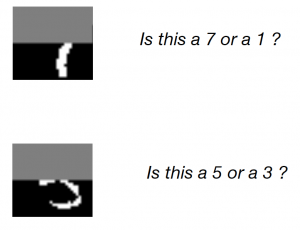

The better approximation properties of splines (compared to classical finite element analysis) gives isogeometric analysis a clear advantage concerning the number of degrees of freedom that is needed to obtain a certain accuracy of the numerical solution to a partial differential equation. Nevertheless few challenges arise, including geometry preprocessing, computational costs, numerical integration and local refinement.

Short Bio

Angelos Mantzaflaris holds a license in mathematics and a M.Sc. in computer science from the University of Athens, Greece. He obtained his Ph.D. degree in computer science by Inria/ED STIC, in the frame of an EU Marie Curie fellowship. After his thesis he served as a researcher at the Austrian Academy of Sciences and its Radon Institute Institute for Applied Mathematics for several years, and was recruited in 2019 by the Aromath team at Sophia. His research interests span isogeometric analysis, geometric modeling, Computer-aided Geometric Design (CAGD), symbolic-numeric computations, algorithmic geometry.

Angelos Mantzaflaris holds a license in mathematics and a M.Sc. in computer science from the University of Athens, Greece. He obtained his Ph.D. degree in computer science by Inria/ED STIC, in the frame of an EU Marie Curie fellowship. After his thesis he served as a researcher at the Austrian Academy of Sciences and its Radon Institute Institute for Applied Mathematics for several years, and was recruited in 2019 by the Aromath team at Sophia. His research interests span isogeometric analysis, geometric modeling, Computer-aided Geometric Design (CAGD), symbolic-numeric computations, algorithmic geometry.

The presentation will be in English and streamed on BBB